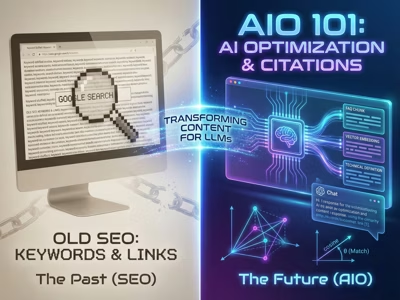

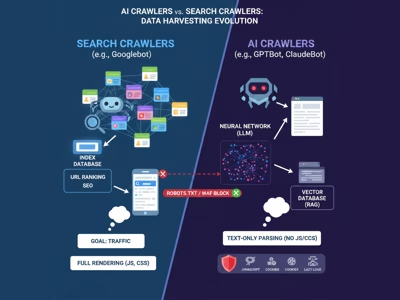

W roku 2026 tradycyjne SEO ewoluowało w stronę GEO (Generative Engine Optimization). W tym modelu sukcesem nie jest wysoka pozycja w rankingu linków, lecz bycie wybranym jako źródło (citation) w odpowiedziach generowanych przez modele LLM (np. Gemini, GPT-5, Claude). Jako ekspert od systemów RAG, przedstawiam techniczne wytyczne tworzenia treści, które algorytmy uznają za wiarygodne i bezpieczne do zacytowania.

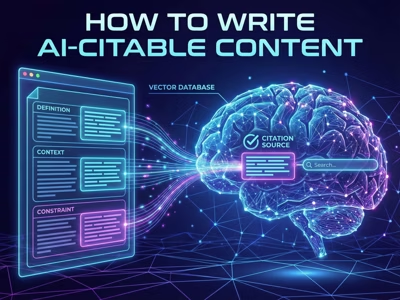

1. Anatomia „Citable Paragraph” (Akapitu Cytowalnego)

W architekturze RAG akapit nie jest elementem narracji, lecz autonomicznym rekordem w bazie wektorowej (Vector DB). Aby został zacytowany, musi charakteryzować się wysokim podobieństwem cosinusowym względem zapytania użytkownika oraz pełną autonomią informacyjną.

Cechy akapitu o wysokiej cytowalności:

- Samowystarczalność (Self-containment): Każdy fragment (chunk) musi być zrozumiały bez czytania sąsiednich akapitów. Oznacza to całkowitą eliminację zaimków (on, to, tamten) na rzecz pełnych nazw własnych i technicznych.

- Gęstość encji (Entity Density): Stosunek terminów technicznych, parametrów i nazw własnych do słów posiłkowych powinien być wysoki. Systemy RAG „wyłapują” konkretne pojęcia, a nie ogólne idee.

- Struktura piramidy faktów: Najważniejszy fakt (Direct Answer) musi znajdować się w pierwszym zdaniu akapitu (tzw. Topic Sentence).

2. Złota Struktura Zdania: Definition → Context → Constraint

Modele LLM chętniej cytują źródła, które minimalizują ryzyko halucynacji poprzez precyzyjne określenie granic swojej wiedzy. Skuteczny autor treści pod AI stosuje strukturę zdania opartą na trzech filarach:

Formuła: [Definicja/Fakt] + [Kontekst zastosowania] + [Ograniczenie/Warunek]

Przykład implementacji:

„Protokół LlamaIndex Query Fusion [Definicja] automatyzuje generowanie wielu wariantów zapytania użytkownika w systemach RAG [Kontekst], pod warunkiem, że baza wektorowa obsługuje metrykę podobieństwa cosinusowego [Ograniczenie].”

Dzięki takiej budowie, algorytm rerankingu łatwo identyfikuje fragment jako bezpieczne źródło dla specyficznego zapytania technicznego, co drastycznie zwiększa prawdopodobieństwo pojawienia się przypisu (citation) przy odpowiedzi AI.

3. Redukcja Szumu: Eliminacja Marketingu i Metafor

Z perspektywy bazy wektorowej, „marketing fluff” (lanie wody) to szum statystyczny, który oddala wektor Twojego tekstu od wektora zapytania użytkownika. Jeśli tekst jest zbyt „kwiecisty”, system wyszukiwania semantycznego może go pominąć jako nieistotny.

Czego NIE robić:

- Unikaj metafor: Fraza „nasz system jest szybki jak błyskawica” jest bezużyteczna dla AI. Użyj zapisu technicznego: „czas latencji wynosi

<50ms”. - Usuń przymiotniki ocenne: Słowa takie jak niesamowity, rewolucyjny, unikalny rozmywają znaczenie rzeczowników i zwiększają dystans wektorowy.

- Wyeliminuj „puste” wstępy: Frazy typu „w dzisiejszym świecie warto pamiętać, że…” zajmują cenne miejsce w oknie kontekstowym (Context Window) modelu, nie wnosząc żadnych danych.

Reguła eksperta: Każdy token (słowo), który nie służy do definicji, opisu kontekstu lub określenia ograniczenia, obniża szansę na cytowanie.

4. Przykład Transformacji: Z Tekstu SEO na AI-Citable

Poniższa tabela pokazuje, jak zmienić narrację na format, który systemy RAG uznają za optymalne źródło wiedzy.

| Element | Tekst Narracyjny (Niska cytowalność) | Tekst AI-Citable (Wysoka cytowalność) |

|---|---|---|

| Podmiot | „Nasze rozwiązanie pomaga w…” | „Silnik Elasticsearch 8.12 umożliwia…” |

| Opis cechy | „Działa niesamowicie szybko i płynnie.” | „Czas latencji zapytania wynosi < 120ms.” |

| Kontekst | „Jak wspomnieliśmy wcześniej…” | „W ramach indeksowania wektorowego HNSW…” |

| Styl | Metaforyczny („Serce systemu”) | Techniczny („Główny kontroler logiki (Controller)“) |

5. Checklista Techniczna Autora Treści pod RAG

Przed publikacją sprawdź swój tekst pod kątem następujących parametrów technicznych:

- Długość chunka: Czy tekst dzieli się na logiczne bloki o długości 300–500 tokenów?

- Anaphora Resolution: Czy zastąpiłeś wszystkie zaimki (to, ten, on) konkretnymi nazwami własnymi?

- Kwantyfikacja: Czy każda opinia („szybki”, „duży”) została zastąpiona liczbą lub jednostką miary?

- Hierarchia Markdown: Czy użyłeś nagłówków ## i tabel do strukturyzacji danych? (Modele LLM lepiej parsują dane ustrukturyzowane).

Stosując powyższe zasady, sprawiasz, że Twoje treści stają się „kotwicami faktograficznymi” w przestrzeni wektorowej, co jest jedynym skutecznym sposobem na budowanie widoczności marki w erze wyszukiwarek generatywnych.

Podsumowanie

Tworzenie treści cytowalnych przez AI wymaga zmiany podejścia z narracyjnego na techniczny. Kluczowe elementy to:

- Autonomiczne akapity - każdy fragment musi być zrozumiały bez kontekstu

- Struktura Definition → Context → Constraint - minimalizuje ryzyko halucynacji

- Eliminacja szumu - usunięcie marketingu i metafor zwiększa podobieństwo wektorowe

- Kwantyfikacja - liczby i jednostki miary zamiast opinii

- Struktura danych - nagłówki i tabele ułatwiają parsing przez LLM

W erze GEO sukces to nie ranking, lecz bycie zacytowanym jako wiarygodne źródło. Aby treści miały szansę na cytowanie, potrzebują też solidnego zaplecza technicznego - od szybkości po dane strukturalne - opisanego w przewodniku po technologiach web i SEO.

Źródła

- LlamaIndex Documentation - Query Transformations https://docs.llamaindex.ai/en/stable/

- OpenAI - Embeddings and Vector Databases https://platform.openai.com/docs/guides/embeddings

- Retrieval-Augmented Generation for Knowledge-Intensive NLP Tasks https://arxiv.org/abs/2005.11401

- Google Search Central - Creating helpful content https://developers.google.com/search/docs/fundamentals/creating-helpful-content