W 2026 roku mapa strony sitemap.xml przestała być tylko listą linków dla Googlebota. Stała się manifestem wiedzy, który zasila systemy RAG (Retrieval-Augmented Generation) i modele AI. Poprawna analiza mapy pozwala nie tylko na szybszą indeksację, ale przede wszystkim na kontrolę jakości danych, które trafiają do bazy wektorowej wyszukiwarek.

Analiza sitemap.xml pomaga wykryć:

- Błędne URL-e — strony zwracające 404 lub redirecty

- Brakujące meta tagi — strony bez tytułu lub opisu

- Duplikaty treści — identyczne tytuły na różnych URL-ach

- Zbyt długie/krótkie tytuły — problemy z SERP snippets

- Thin content — strony z niedostateczną ilością treści

- Nieaktualne strony — content do usunięcia lub aktualizacji

Tradycyjne metody analizy vs Uper SEO Auditor

Screaming Frog

Popularny crawler desktopowy, ale:

- Wymaga instalacji (Windows/Mac)

- Darmowa wersja do 500 URL-ów

- Crawluje całą stronę, nie tylko sitemapę

- Brak natywnej analizy meta tagów z poziomu sitemapy

Google Search Console

Pokazuje status indeksowania, ale:

- Brak eksportu pełnych danych

- Ograniczone informacje o meta tagach

- Dane z opóźnieniem (nawet kilka dni)

Ręczna analiza

Możesz otworzyć sitemap.xml i sprawdzać URL-e jeden po drugim. Przy 50 stronach zajmie to godzinę. Przy 500 — cały dzień.

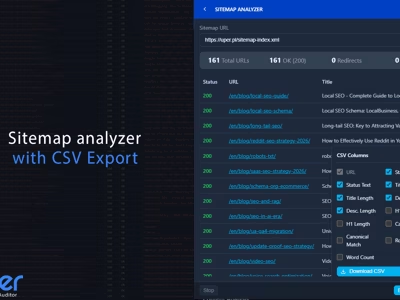

Sitemap Analyzer w Uper SEO Auditor

Rozszerzenie UPER SEO Auditor zawiera wbudowany analizator sitemap, który działa bezpośrednio w przeglądarce:

- Pobiera wszystkie URL-e z sitemap.xml

- Sprawdza tytuł i opis meta każdej strony

- Pokazuje długość znaków i kody HTTP

- Wykrywa thin content, duplikaty i redirecty

- Eksportuje wyniki do CSV

Gdzie robot zaczyna pracę?

Mapa strony to drogowskaz. Aby robot (lub scraper AI) go znalazł, musi on widnieć w pliku robots.txt. Wtyczka Uper SEO Auditor automatycznie parsuje zawartość robots.txt w poszukiwaniu dyrektywy Sitemap:. To pierwszy test — jeśli mapa nie jest tam zadeklarowana, marnujesz budżet crawlingu na błądzenie robota po strukturze linków wewnętrznych.

Możesz też wpisać własny URL, np. /sitemap_index.xml lub /news-sitemap.xml.

Sitemap Analyzer w panelu bocznym Chrome z analizą sitemapy i podsumowaniem wykrytych problemów.

Sitemap Analyzer w panelu bocznym Chrome z analizą sitemapy i podsumowaniem wykrytych problemów.

Proces analizy i Rate Limiting

Po kliknięciu „Analyze” rozszerzenie:

- Pobiera sitemap.xml — parsuje XML i wyciąga wszystkie URL-e

- Obsługuje sitemap index — jeśli sitemap zawiera linki do innych sitemap, pobiera je rekursywnie

- Sprawdza każdy URL — batch processing z rate limiting (5 żądań równolegle)

- Wyciąga meta dane — tytuł, opis, status HTTP, liczbę słów

Bezpieczeństwo serwera

Aby nie przeciążyć serwera, analizator:

- Wysyła max 5 żądań jednocześnie

- Czeka 200ms między partiami

- Pozwala zatrzymać analizę w dowolnym momencie

Te zabezpieczenia oznaczają, że możesz bezpiecznie analizować nawet duże witryny bez ryzyka zablokowania przez serwer.

Wyniki analizy

Po zakończeniu zobaczysz tabelę ze wszystkimi URL-ami:

| Kolumna | Opis |

|---|---|

| URL | Pełny adres strony |

| Title | Tytuł strony (z <title>) |

| Title Length | Liczba znaków tytułu |

| Description | Meta description |

| Desc Length | Liczba znaków opisu |

Kliknij nagłówek kolumny, aby posortować wyniki — np. po Title Length, by szybko znaleźć zbyt krótkie/długie tytuły.

Koniec z Priority i Changefreq (Case Study: WhitePress)

Wielu specjalistów SEO wciąż traci czas na ustawianie parametrów <priority> oraz <changefreq>. Badanie mapy strony WhitePress (4473 adresy URL) za pomocą wtyczki Uper wyraźnie pokazuje, że te pola są dziś całkowicie ignorowane przez Google. Roboty same decydują o częstotliwości odwiedzin na podstawie autorytetu i aktualizacji treści. Skupienie się na tych tagach to powielanie mitów sprzed dekady.

Audyt sitemapy WhitePress — wszystkie 4473 URL używają przestarzałych pól priority i changefreq, które Google ignoruje.

Audyt sitemapy WhitePress — wszystkie 4473 URL używają przestarzałych pól priority i changefreq, które Google ignoruje.

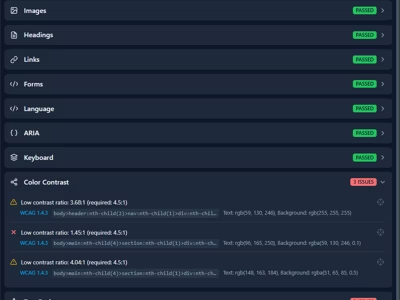

Issues Summary: techniczny rentgen treści (Case Study: Linkhouse)

Moduł Issues Summary pozwala na błyskawiczne wyłapanie błędów semantycznych. Na przykładzie audytu domeny linkhouse.pl (318 adresów URL) widzimy problemy, które bezpośrednio wpływają na to, jak AI „rozumie” Twoją stronę.

Thin content (< 300 słów)

11 podstron (ok. 3%) posiada zbyt małą dawkę treści. Dla systemów AI takie strony są bezużyteczne — nie wnoszą wartości do bazy wiedzy i mogą obniżać ogólną ocenę jakości witryny.

Błędy meta tagów

Wykryto 140 tytułów zbyt długich (>60 znaków) oraz 10 przypadków braku nagłówka H1. Bez jasnej hierarchii scrapery AI mają problem z poprawnym „szatkowaniem” tekstu na fragmenty (chunks).

Redirects (3xx)

24 adresy w mapie to przekierowania. Mapa powinna zawierać wyłącznie finalne adresy (200 OK). Przesyłanie redirectów to marnowanie zasobów Google.

Issues Summary dla linkhouse.pl — 140 zbyt długich tytułów, 24 redirecty i 11 stron z thin content.

Issues Summary dla linkhouse.pl — 140 zbyt długich tytułów, 24 redirecty i 11 stron z thin content.

Sitemap Analyzer — interaktywny podgląd

Przycisk „Preview in New Tab” otwiera pełny audyt w układzie SERP-style. Możesz tu ocenić, jak Twoje podstrony prezentują się „oczami robota”. Filtrowanie pozwala błyskawicznie wyłuskać np. adresy ze zbyt długimi tytułami, co doskonale widać w szczegółowym audycie WhitePress.

Widok Preview dla Linkhouse — pełna lista URL z tytułami, opisami i statystykami linków.

Widok Preview dla Linkhouse — pełna lista URL z tytułami, opisami i statystykami linków.

Audyt WhitePress — widoczne zduplikowane tytuły stron, które wymagają unikalnych opisów.

Audyt WhitePress — widoczne zduplikowane tytuły stron, które wymagają unikalnych opisów.

Extract URLs: od analizy do naprawy

Jedną z najmocniejszych funkcji Uper jest Extract URLs. Narzędzie pozwala na inteligentne filtrowanie danych przed eksportem. Możesz np. wyodrębnić wyłącznie niedziałające linki (Broken Links 4xx/5xx) z sitemapy WhitePress i pobrać je w formacie CSV do natychmiastowej naprawy.

Filtrowanie URL po kodach HTTP — szybkie wyodrębnienie stron z błędami 404 i 301.

Filtrowanie URL po kodach HTTP — szybkie wyodrębnienie stron z błędami 404 i 301.

Audyt WhitePress — 1562 zduplikowane URL-e i 1905 zduplikowanych tytułów do natychmiastowej naprawy.

Audyt WhitePress — 1562 zduplikowane URL-e i 1905 zduplikowanych tytułów do natychmiastowej naprawy.

Wypróbuj Uper SEO Auditor

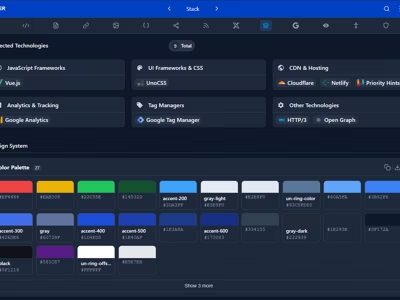

Bezpłatna wtyczka do Chrome, która analizuje sitemapę, meta tagi, Web Vitals i dziesiątki innych parametrów technicznych — bezpośrednio w panelu bocznym przeglądarki.

Zainstaluj za darmo Chrome Web StorePraktyczne zastosowania danych z audytu

Po wyeksportowaniu danych do CSV możesz otworzyć je w Google Sheets, Microsoft Excel, LibreOffice Calc lub Numbers i przeprowadzić pogłębioną analizę.

URL,Title,Title Length,Description,Description Length

https://example.com/,Example Site - Home,22,Welcome to Example Site,24

https://example.com/about/,About Us | Example,19,Learn about our company,24

https://example.com/contact/,Contact - Example Site,22,,01. Audyt tytułów SEO

Optymalny tytuł ma 50-60 znaków. W arkuszu użyj formuły:

=IF(C2<30,"Za krótki",IF(C2>60,"Za długi","OK"))2. Znajdowanie stron bez opisu

Filtruj kolumnę „Desc Length” po wartości 0. Te strony wymagają uzupełnienia meta description.

3. Wykrywanie duplikatów tytułów

W arkuszu użyj formatowania warunkowego, aby podświetlić powtarzające się tytuły:

- Zaznacz kolumnę Title

- Format → Formatowanie warunkowe

- Reguła: „Formuła niestandardowa” →

=COUNTIF(B:B,B1)>1

4. Analiza struktury URL

Eksportowane URL-e możesz podzielić na segmenty i przeanalizować:

- Które kategorie mają najwięcej stron?

- Jak głęboka jest struktura URL?

- Czy są nieoczekiwane ścieżki?

5. Porównanie z indeksem Google

Porównaj listę URL-ów z sitemapy z danymi z Google Search Console:

- Eksportuj URL-e z Sitemap Analyzer

- Eksportuj zaindeksowane strony z GSC

- Znajdź różnice (URL-e w sitemap, ale nie w indeksie)

Comparison View — monitoring zmian w czasie

Ponowna analiza tej samej sitemapy aktywuje tryb Comparison View. To tutaj widać dynamikę zmian — co zostało zmodyfikowane między analizami, ze szczegółowym porównaniem starych i nowych wartości meta tagów.

Dla systemów RAG to krytyczny proces pruningowania (content pruning — czyszczenia) bazy danych. Jeśli z mapy zniknęły kluczowe sekcje, system AI musi zostać poinformowany, aby usunąć stare embeddingi i nie generować odpowiedzi na podstawie nieistniejących już treści.

Comparison View — porównanie zmian w opisach i datach modyfikacji między analizami.

Comparison View — porównanie zmian w opisach i datach modyfikacji między analizami.

Sitemap a Google Search Console

W raporcie „Strony” w GSC użyj filtra „Wszystkie przesłane strony”. Jeśli zobaczysz dużą liczbę adresów „wykrytych, ale nieindeksowanych” — jak na poniższym przykładzie, gdzie z 28,7 tys. znanych stron zaindeksowanych jest zaledwie 5,16 tys. — to sygnał alarmowy.

Google Search Console — ponad 80% stron nie jest zaindeksowanych. Najczęstsze przyczyny: duplikaty, redirecty i brak treści.

Google Search Console — ponad 80% stron nie jest zaindeksowanych. Najczęstsze przyczyny: duplikaty, redirecty i brak treści.

Najczęstsze przyczyny widoczne w raporcie GSC to „Duplicate without user-selected canonical”, „Page with redirect” i „Crawled — currently not indexed”. Każdy z tych problemów da się zidentyfikować i naprawić w Uper SEO Auditor — thin content i redirecty znajdziesz w Issues Summary, a duplikaty tytułów i opisów wyłapiesz w widoku Preview.

Zaawansowane skalowanie i multimedia

Przy dużych serwisach nie zapominaj o dodatkowych typach map strony i technikach skalowania.

Sitemap Index

Podział na wiele plików (do 50 000 URL każdy) dla lepszej priorytetyzacji. Dzięki temu roboty mogą efektywniej przetwarzać duże witryny, a Ty zyskujesz kontrolę nad kolejnością indeksacji poszczególnych sekcji.

Video/Image Sitemap

Dostarczanie transkrypcji i opisów multimediów pod kątem wyszukiwania wizualnego AI. Wraz z rozwojem multimodalnych modeli, takich jak Gemini czy GPT-4o, te dane stają się coraz cenniejsze.

Hreflang w XML

Najczystszy sposób na mapowanie wersji językowych bez obciążania sekcji <head>. Szczególnie ważne przy dużych serwisach wielojęzycznych, gdzie hreflang w HTML potrafi znacząco zwiększyć rozmiar dokumentu.

Obsługa dużych sitemap

Sitemap Analyzer radzi sobie z dużymi witrynami:

- Sitemap index — automatycznie pobiera wszystkie podmapy

- Limit bezpieczeństwa — max 100 000 URL-ów

- Możliwość zatrzymania — przycisk Stop w dowolnym momencie

- Wyniki częściowe — możesz wyeksportować dane nawet po przerwaniu

Wskazówki dla dużych witryn

- Testuj na mniejszej sitemap — np.

/blog-sitemap.xmlzamiast index - Analizuj w częściach — podziel analizę na kategorie

- Eksportuj regularnie — zapisuj wyniki przed kontynuacją

Checklista: techniczny audyt sitemapy

- Deklaracja: Czy sitemap jest w robots.txt?

- Kody HTTP: Czy wyeliminowałeś wszystkie 3xx i 4xx (użyj filtra w Extract URLs)?

- Metadane: Czy usunąłeś błędy „Missing H1” i „Title too long”?

- Treść: Czy strony „Thin content” zostały rozbudowane lub usunięte z mapy?

- Duplikaty: Czy tytuły i opisy są unikalne (użyj formatowania warunkowego w arkuszu)?

- Higiena: Czy czyścisz stare dane w Cached Data Management, by widzieć stan faktyczny?

Zarządzanie danymi z cache — ponowna analiza ujawnia zmiany od ostatniego audytu.

Zarządzanie danymi z cache — ponowna analiza ujawnia zmiany od ostatniego audytu.

Podsumowanie

Analiza sitemapy za pomocą Uper SEO Auditor na przykładach takich platform jak Linkhouse i WhitePress udowadnia, że nawet najwięksi gracze muszą dbać o higienę plików XML. Narzędzie łączy zaawansowaną diagnostykę (Issues Summary, Comparison View) z praktycznymi funkcjami eksportu, które pozwalają na dalszą obróbkę danych w arkuszach kalkulacyjnych. W 2026 roku czysta mapa strony to fundament widoczności w świecie algorytmów AI.

Wypróbuj UPER SEO Auditor i przeanalizuj sitemapę swojej strony.

Źródła

-

Google Search Central: Sitemaps overview https://developers.google.com/search/docs/crawling-indexing/sitemaps/overview

-

Google Search Central: Build and submit a sitemap https://developers.google.com/search/docs/crawling-indexing/sitemaps/build-sitemap

-

Sitemaps.org: XML format https://www.sitemaps.org/protocol.html

-

Google Search Console: Sitemap report https://support.google.com/webmasters/answer/7451001