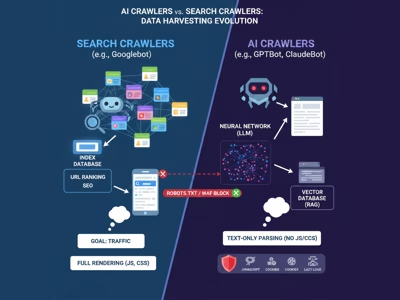

W tradycyjnym ekosystemie sieciowym boty dzieliły się na „dobre” (wyszukiwarki) i „złe” (scrapers). Pojawienie się modeli językowych (LLMs) wprowadziło trzecią kategorię: AI Crawlers.

Choć technicznie bazują na podobnych protokołach co Googlebot, ich cel, zachowanie i sposób przetwarzania danych są fundamentalnie różne. Zrozumienie tych różnic jest kluczowe dla zarządzania widocznością i ochrony własności intelektualnej w 2026 roku.

1. Cel wizyty: Indeksowanie vs. Trening (Pre-training & RAG)

Główną różnicą jest przeznaczenie danych. Search Crawlers (np. Googlebot, Bingbot) budują indeks odsyłaczy. Ich celem jest skierowanie użytkownika pod konkretny adres URL.

AI Crawlers (np. GPTBot, ClaudeBot, CCBot) zbierają dane w dwóch celach:

- Pre-training: Budowa wag modelu. Dane są tokenizowane i tracą swoją strukturę źródłową, stając się częścią probabilistycznego modelu języka.

- RAG (Retrieval-Augmented Generation): Pobieranie treści w czasie rzeczywistym, aby zasilić kontekst zapytania użytkownika (np. SearchGPT lub Perplexity). Tutaj bot szuka konkretnych faktów, a nie buduje rankingu stron.

2. Techniczne ograniczenia: JS, Cookies i Lazy Loading

W przeciwieństwie do nowoczesnego Googlebota, który dysponuje potężnym silnikiem renderującym (Evergreen Chromium), wiele botów AI operuje na uproszczonych parserach tekstowych.

- JavaScript: Większość AI crawlerów (szczególnie tych budujących zbiory typu Common Crawl) ma trudności z renderowaniem ciężkich aplikacji SPA (React, Vue). Jeśli treść nie jest dostępna w kodzie źródłowym HTML (SSR), bot AI może jej „nie widzieć”.

- Cookies i Sesje: Boty AI niemal zawsze ignorują ciasteczka. Nie przechodzą przez paywalle oparte na sesjach ani nie wchodzą w interakcję z elementami wymagającymi autoryzacji.

- Lazy Loading: Ponieważ boty AI często nie przewijają stron (nie symulują zachowania użytkownika), obrazy i sekcje tekstowe ładowane asynchronicznie (lazy-load) są dla nich niewidoczne, o ile nie są zdefiniowane w tagach

<noscript>lub sitemapach.

3. Częstotliwość i wzorce skanowania

Search Crawlers działają w pętli ciągłej, priorytetyzując strony o wysokim autorytecie i często aktualizowane (News). Częstotliwość odwiedzin zależy od budżetu crawlingu (crawl budget).

AI Crawlers wykazują inne wzorce:

- Batch Crawling: Boty zbierające dane do treningu (jak GPTBot) mogą uderzać w serwer falami raz na kilka miesięcy, pobierając ogromne ilości danych w krótkim czasie, co przypomina atak DDoS.

- On-demand Crawling: Boty typu “Search AI” odwiedzają stronę w milisekundach po zapytaniu użytkownika. Częstotliwość jest tu bezpośrednio skorelowana z popularnością tematu w zapytaniach do modelu AI, a nie z autorytetem domeny w SEO.

4. Rola Cloudflare i WAF: Ciche blokowanie

Wielu właścicieli stron nie zdaje sobie sprawy, że ich systemy bezpieczeństwa domyślnie blokują AI. Cloudflare oraz zaawansowane Web Application Firewalls (WAF) wprowadziły dedykowane reguły „AI Scrapers and Crawlers”.

- Automatyczna blokada: Jeśli w panelu Cloudflare włączona jest opcja “Block AI Crawlers”, system analizuje User-Agent oraz sygnatury IP. Boty takie jak GPTBot są odrzucane na poziomie brzegu sieci (Edge), zanim w ogóle dotkną serwera WWW.

- False Positives: Czasami agresywne reguły anty-botowe (Bot Management) klasyfikują AI crawlery jako złośliwe skrypty ze względu na brak nagłówków typowych dla przeglądarek, co skutkuje błędem 403 Forbidden.

- Robots.txt vs. WAF: Pamiętaj, że robots.txt to tylko prośba o nieindeksowanie. WAF to fizyczna bariera.

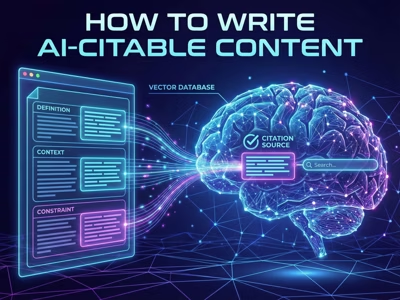

5. Co faktycznie “widzi” AI? (Gęstość Informacyjna)

Dla systemów RAG najważniejsza jest czysta treść. AI crawlers ignorują:

- Layout i design (CSS).

- Reklamy i pop-upy (chyba że przesłaniają kod HTML).

- Nawigację (header/footer) – zaawansowane boty stosują algorytmy de-noisingu, aby wyekstrahować tylko główny artykuł (Main Content).

Warto zadbać o semantyczną strukturę HTML (znaczniki <article>, <h1>-<h3>), ponieważ to one ułatwiają modelom podział tekstu na sensowne chunki podczas indeksowania w bazach wektorowych.

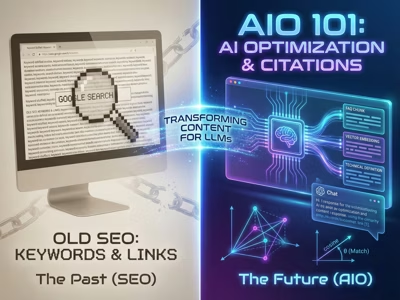

6. Kontrola dostępu: Robots.txt w dobie AI

Tradycyjne podejście do robots.txt ewoluowało. Obecnie nie wystarczy zablokować „wszystkiego”, jeśli chcemy, aby nasza treść pojawiała się w odpowiedziach AI z cytowaniami, ale nie służyła do darmowego trenowania modeli bazowych.

- Granularność blokowania: Możesz różnicować dostęp dla konkretnych botów. Na przykład, blokując GPTBot (trening), ale zezwalając na OAI-SearchBot (odpowiedzialny za SearchGPT i wyszukiwanie w czasie rzeczywistym).

- Nowe standardy: OpenAI, Google i Anthropic wprowadziły dedykowane tokeny User-Agent. Brak wpisu w robots.txt jest traktowany jako dorozumiana zgoda na skanowanie.

- Problem “Common Crawl”: Wiele modeli AI (np. Llama) trenuje się na zbiorze CCBot. Zablokowanie go chroni przed dziesiątkami mniejszych modeli, które nie mają własnych crawlerów.

| User-Agent | Firma / Model | Funkcja | Rekomendacja |

|---|---|---|---|

| GPTBot | OpenAI | Trening modeli (np. GPT-5) | Blokuj (ochrona IP) |

| OAI-SearchBot | OpenAI | Wyszukiwanie SearchGPT | Zezwalaj (ruch/cytowania) |

| ClaudeBot | Anthropic | Trening i analiza | Blokuj/Zezwalaj (zależnie od strategii) |

| Googlebot | SEO i AI Overviews | Zezwalaj (krytyczne dla Google) |

7. Paradoks AI-Indexingu

W systemach RAG pojawia się nowe wyzwanie: optymalizacja fragmentacji. Jeśli zablokujesz boty AI w robots.txt, Twoja treść nie trafi do ich “pamięci długotrwałej” (trening). Jednak jeśli boty RAG (real-time) napotkają blokadę w WAF lub robots.txt, Twój brand nie pojawi się w przypisach pod generowaną odpowiedzią.

Dla systemów RAG informacja nieistniejąca w indeksie jest informacją nieprawdziwą (hallucination risk) lub pominiętą. Dlatego strategiczne zarządzanie dostępem staje się nową formą technicznego SEO.

Gotowy szablon robots.txt (Strategia Hybrydowa)

Oto gotowy do skopiowania kod pliku robots.txt, zoptymalizowany pod kątem nowoczesnych systemów RAG i wyszukiwarek. Konfiguracja ta realizuje strategię “Protect Training, Allow Search” – chroni Twoją własność intelektualną przed wykorzystaniem do trenowania modeli, ale pozwala na generowanie ruchu z wyszukiwarek AI.

# 1. ZEZWÓL NA TRADYCYJNE SEO (Google, Bing)

User-agent: Googlebot

Allow: /

User-agent: Bingbot

Allow: /

# 2. ZEZWÓL NA SEARCH AI (Ruch i cytowania w czasie rzeczywistym)

# Pozwala SearchGPT i wyszukiwarce Google na dostęp do treści

User-agent: OAI-SearchBot

Allow: /

User-agent: Googlebot-Extended

Allow: /

# 3. BLOKUJ TRENOWANIE MODELI (Ochrona własności intelektualnej)

# Blokuje pobieranie danych do baz treningowych GPT-5, Claude, etc.

User-agent: GPTBot

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: CCBot

Disallow: /

User-agent: Anthropic-ai

Disallow: /

# 4. BLOKUJ AGRESYWNE SKRAPERY AI I NARZĘDZIA DO RAG BEZ CYTOWAŃ

User-agent: PerplexityBot

Disallow: /

User-agent: ImagesiftBot

Disallow: /Dlaczego to jest ważne dla Twojej bazy wektorowej?

Zastosowanie powyższego schematu ma bezpośredni wpływ na to, jak systemy Retrieval-Augmented Generation traktują Twoje dane:

- Zmniejszenie szumu: Blokując boty treningowe (jak CCBot), ograniczasz ryzyko, że Twoja treść zostanie “rozmyta” w wagach modelu bez podania źródła.

- Zapewnienie świeżości (Recency): Pozwalając na OAI-SearchBot, sprawiasz, że gdy użytkownik zapyta o Twój produkt w ChatGPT, system wykona “live crawl”. Dzięki temu do bazy wektorowej trafi aktualna wersja strony, a nie ta sprzed roku z bazy treningowej.

- Atrybucja: Boty typu “Search” zazwyczaj generują linki zwrotne. Boty “Training” – prawie nigdy.

Konfiguracja Cloudflare WAF: Tarcza przeciw AI

Wdrożenie blokady na poziomie Cloudflare WAF (Web Application Firewall) to jedyny sposób na fizyczne zatrzymanie botów, które ignorują instrukcje robots.txt. W przypadku systemów RAG, chroni to Twoje zasoby serwerowe przed niepotrzebnym obciążeniem (tzw. “scraping fatigue”).

W panelu Cloudflare przejdź do sekcji Security → WAF → Custom Rules. Stwórz nową regułę, która pozwoli na odfiltrowanie botów treningowych przy zachowaniu dostępu dla wyszukiwarek.

1. Wyrażenie logiczne (Expression Editor)

Skopiuj poniższy kod do edytora wyrażeń, aby zidentyfikować boty, które chcemy ograniczyć:

(http.user_agent contains "GPTBot") or

(http.user_agent contains "ClaudeBot") or

(http.user_agent contains "CCBot") or

(http.user_agent contains "PerplexityBot") or

(http.user_agent contains "Anthropic-ai")2. Wybór akcji

Zamiast całkowitego blokowania (Block), które może być błędem, jeśli bot zaktualizuje swój User-Agent, rekomenduję akcję Managed Challenge (Interactive Challenge).

Dlaczego? Prawdziwe boty AI nie przejdą testu JavaScript/Captcha, więc zostaną zablokowane. Jeśli jednak prawdziwy użytkownik (człowiek) używa specyficznej przeglądarki, która mogłaby zostać pomylona z botem, będzie mógł po prostu kliknąć weryfikację.

Kluczowe uwagi dla Ekspertów RAG

Blokowanie na poziomie WAF ma bezpośredni wpływ na Vector Embedding Pipeline zewnętrznych firm:

- Zapobieganie “Data Poisoning”: Kontrolując, kto pobiera Twoje dane, masz większy wpływ na to, w jakich korpusach treningowych lądują Twoje treści.

- Oszczędność kosztów: AI Crawlers potrafią generować tysiące zapytań w ciągu minuty, co nabija koszty transferu i obciąża bazę danych (np. WordPressa). WAF zatrzymuje te zapytania na “brzegu” (Edge), zanim dotrą do Twojej infrastruktury.

- Weryfikacja “Verified Bots”: Cloudflare posiada listę Verified Bots. Upewnij się, że nie blokujesz całej kategorii “Bots”, a jedynie konkretne User-Agenty. Googlebot znajduje się na liście zweryfikowanej, więc standardowe reguły Cloudflare go nie dotkną.

Wskazówka ekspercka: Zawsze monitoruj zakładkę Security → Events. Jeśli zobaczysz dużą liczbę blokad z tagiem OAI-SearchBot, a zależy Ci na ruchu z SearchGPT, usuń ten konkretny User-Agent z reguły WAF.

TL;DR: AI vs. Search Crawlers – Kluczowe Różnice

- Cel: Googlebot indeksuje pod kątem linków i rankingu (SEO). Boty AI (GPTBot, ClaudeBot) skrapują treść do baz treningowych (LLM) lub weryfikacji faktów w czasie rzeczywistym (RAG).

- Technologia: AI Crawlers często ignorują JavaScript i Lazy Loading. Treści serwowane wyłącznie przez JS (klient-side) są dla nich niewidoczne, co wymaga stosowania SSR (Server-Side Rendering).

- Kontrola (Robots.txt): Tradycyjne SEO wymaga

Allow: Googlebot. Ochrona własności intelektualnej wymagaDisallow: GPTBotorazCCBot. Strategia hybrydowa pozwala naOAI-SearchBotdla zachowania cytowań w SearchGPT. - Bezpieczeństwo: Cloudflare i systemy WAF mogą blokować AI bez wiedzy właściciela poprzez funkcje „Bot Management”. Konieczna jest ręczna weryfikacja reguł, aby nie odciąć się od ruchu z modeli generatywnych.

- Dla RAG: Optymalizacja pod AI (AIO) wymaga semantycznego kodu HTML i wysokiej jakości czystego tekstu, pozbawionego szumu nawigacyjnego i reklam.

Źródła

- OpenAI - GPTBot Documentation https://platform.openai.com/docs/gptbot

- Google - Google-Extended and AI https://developers.google.com/search/docs/crawling-indexing/overview-google-crawlers

- Cloudflare - Bot Management https://www.cloudflare.com/application-services/products/bot-management/

- Common Crawl - About https://commoncrawl.org/